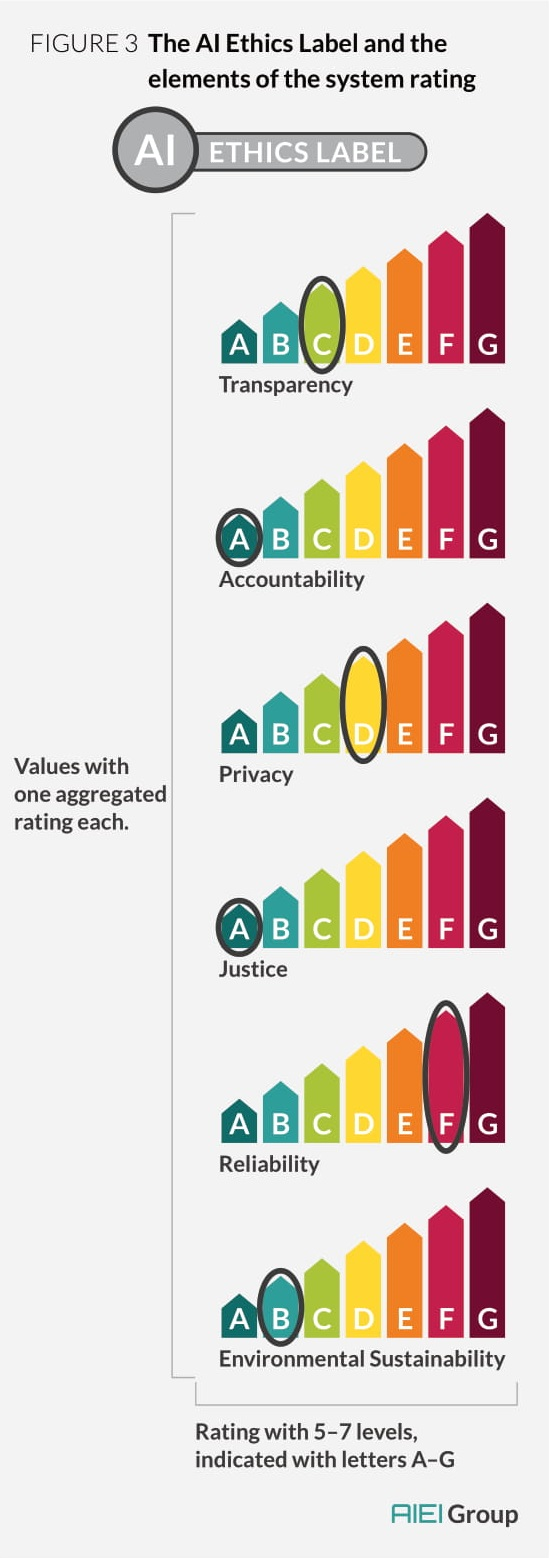

Die AI Ethics Impact Group hat eine Studie zur ethischen Gestaltung von Anwendungen der Künstlichen Intelligenz (KI) veröffentlicht. Kern des Papiers ist die Vorstellung eines Labels zur Kennzeichnung der ethischen Bewertung von KI.

Die AI Ethics Impact Group hat eine Studie zur ethischen Gestaltung von Anwendungen der Künstlichen Intelligenz (KI) veröffentlicht. Kern des Papiers ist die Vorstellung eines Labels zur Kennzeichnung der ethischen Bewertung von KI.

Mit dem zunehmenden Einsatz algorithmischer Systeme in allen Lebensbereichen hat auch die Diskussion über die gesellschaftlichen Auswirkungen der Technologie und die Entwicklung eines „Europäische Wegs zur Künstlichen Intelligenz“ an Fahrt aufgenommen. Menschengerechte und vertrauenswürdige KI sind die Schlagworte, zu denen politische Akteure in Deutschland und auf europäischer Ebene eine Vielzahl an ethischen Richtlinien für die Gestaltung von KI veröffentlicht haben. Obwohl Einigkeit besteht, dass KI-Systeme bestimmten Kriterien wie Fairness, Transparenz oder Datenschutz unterliegen müssen, scheitert es bislang an allgemein messbaren Prinzipien.

Die Frage, wie die Richtlinien konkret umgesetzt werden sollen, bleibt bisher weitgehend unbeantwortet. Es bestehen viele unterschiedliche Verständnisse für Begriffe wie Transparenz und Gerechtigkeit. Dies führt dazu, dass KI-entwickelnden Unternehmen wie auch Anwendern (z. B. der öffentlichen Hand) die nötige Orientierung fehlt und eine wirksame Kontrolle der Systeme nicht möglich ist. Die fehlende Konkretisierung ist somit eines der großen Hindernisse für die Entwicklung und den Einsatz von gemeinwohlorientierter Künstlicher Intelligenz.

Unter der Leitung der gemeinnützigen Normierungsorganisation VDE in Kooperation mit der Bertelsmann Stiftung arbeiten seit Oktober 2019 in der interdisziplinären AI Ethics Impact Group Vertreterinnen und Vertreter unterschiedlicher Universitäten und Organisationen zusammen.

Mit dem Arbeitspapier „AI Ethics: From Principles to Practice – An interdisciplinary framework to operationalise AI ethics“ liegt nun eine Studie vor, die verdeutlicht, wie KI-Ethikprinzipien operationalisiert und in die Praxis überführt werden können. In der AI Ethics Impact Group kamen Expertinnen und Experten aus den Bereichen Informatik, Philosophie, Ingenieurs- und Sozialwissenschaften zusammen. Beteiligt waren neben dem Internationalen Zentrum für Ethik in den Wissenschaften (IZEW) der Universität Tübingen unter anderem Wissenschaftlerinnen und Wissenschaftler des Algorithmic Accountability Labs der TU Kaiserslautern, des Höchstleistungsrechenzentrum der Uni Stuttgart, des Instituts für Technikfolgenabschätzung und Systemanalyse (ITAS) in Karlsruhe, des Instituts für Philosophie der TU Darmstadt und des Thinktanks iRights.Lab.

Zur Pressemitteilung gelangen Sie hier.

Folgen Sie dem Projekt auf Twitter unter #Principles2Practice und #AIEIG,

oder nutzen Sie den direkten Kontakt per E-Mail:

- VDE: Sebastian.Hallensleben@vde.com

- Bertelsmann Stiftung: carla.hustedt@bertelsmann-stiftung.de

- IZEW: jessica.heesen@uni-tuebingen.de

Newsletter: Per Email abonnieren

Newsletter: Per Email abonnieren Auf Twitter folgen

Auf Twitter folgen Auf Facebook folgen

Auf Facebook folgen